Prompt Injection

Andrea Hauser

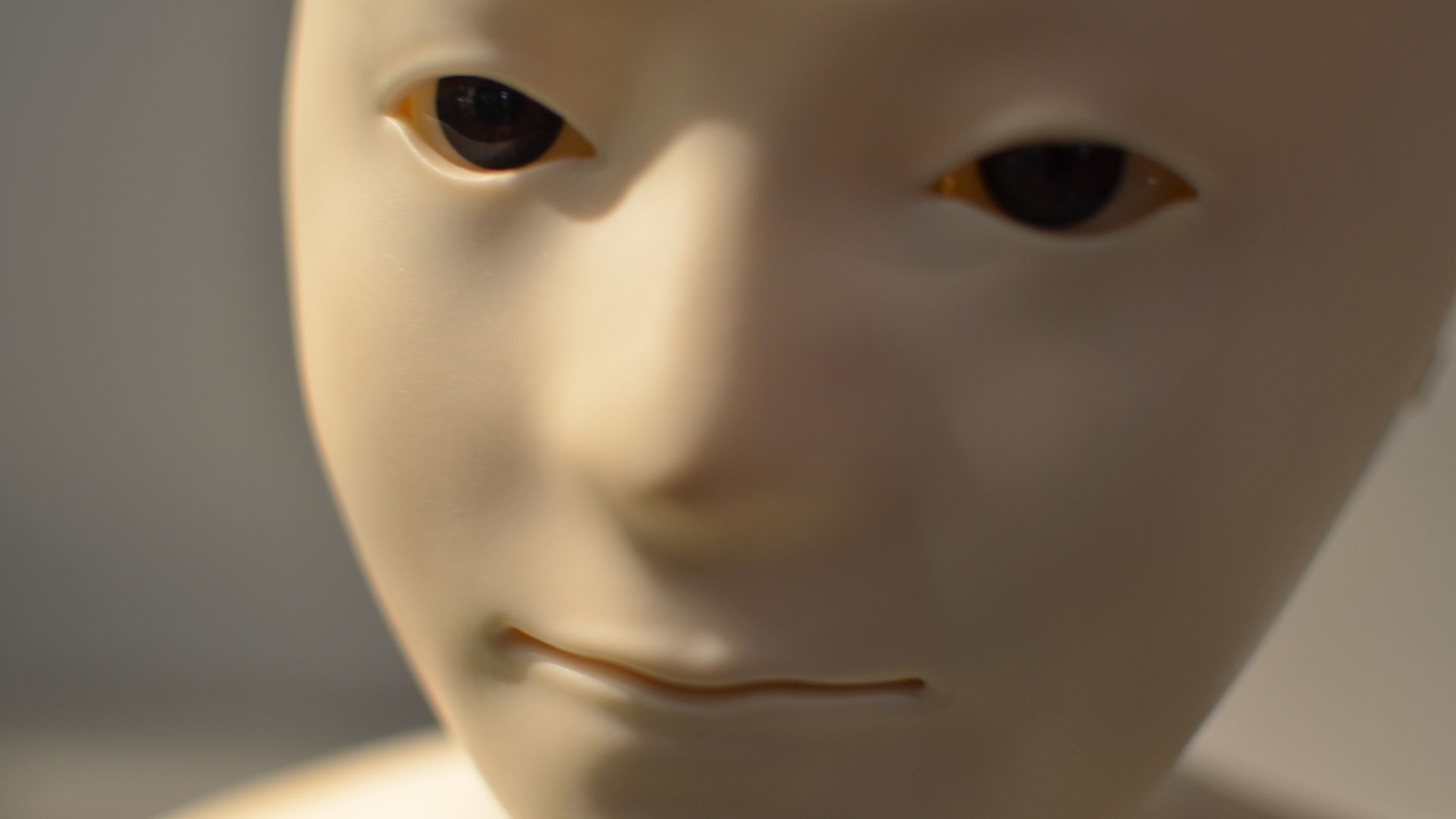

So lassen sich Gesichter in Videos maschinell austauschen

Eine solche Umwandlung konnte früher nur mit sehr guten Video-Editing-Fähigkeiten umgesetzt werden. Heute ist die Technologie für jeden mit genügend Motivation, Zeit und der nötigen Rechenpower zugänglich.

Für die Bekanntheit und Verbreitung von Deepfakes sorgte ein Reddit-Benutzer mit dem Namen “Deepfake” welcher demonstrierte, dass es möglich ist das Gesicht einer prominenten Person zu nehmen und diese Person in einem Porno-Clip auftreten zu lassen. Mit der Erstellung von Applikationen wie zum Beispiel FakeApp, einer GUI-gesteuerten Applikation, wurde es auch für weniger technikaffine Benutzer möglich sogenannte Deepfakes zu erstellen.

Es gibt unterschiedliche Algorithmen um ein Deepfake zu erstellen, jedoch verwenden alle das Prinzip der künstlichen Intelligenz, konkret Deep Learning, welches ein Teilbereich von Machine Learning ist. Dabei werden sogenannte künstliche neuronale Netzwerke verwendet. Im Falle der GUI-gesteuerten Applikation FakeApp werden sogenannte Autoencoder genutzt. Ein Autoencoder ist ein neuronales Netzwerk, welches darauf spezialisiert ist, Inputdaten zu komprimieren und aus den komprimierten Informationen wieder eine möglichst vollständige Repräsentation des Ursprungsbildes herzustellen.

Das erfolgreiche Vertauschen eines Gesichts benötigt mehrere Schritte. Als erstes werden zwei Autoencoder dazu trainiert, die beiden Gesichter der Personen A und B jeweils möglichst genau darzustellen.

Nachdem die beiden Autoencoder erfolgreich ihr jeweiliges Gesicht A oder B repräsentieren können, folgt das eigentliche Austauschen der Gesichter. Dabei wird dem Dekodierer des Gesichts A eine komprimierte Repräsentation des Gesichts B vorgegeben. Der Dekodierer A wird diese Repräsentation in ein Gesicht der Person A umwandeln mit dem Gesichtsausdruck der Person B.

Oft wird bei der Spekulation über Nutzungsfelder für Deepfakes lediglich auf die negative Seite eingegangen, Beispiele sind Pornographie, Fake News oder Erpressungen. Dabei gibt es auch verschiedenste positive Anwendungsfälle. Grosse Möglichkeiten ergeben sich in der Filmbranche, wo es einfacher durchführbar wird verstorbene Schauspieler wieder aufleben zu lassen. Ausserdem ist es möglich, Übersetzungen von Filmen noch realistischer umzusetzen, indem die Mundbewegungen der Schauspieler mit dem effektiv Gesagten übereinstimmen. Des Weiteren ergeben sich ganz neue Möglichkeiten im Bereich dynamische Filme, bei denen die Besetzung teils selbst gewählt werden kann oder bei der ein Zuschauer sich selbst als Darsteller definieren kann. Ein ähnliches Prinzip lässt sich auch auf die Werbebranche übertragen. So wäre es zum Beispiel für eine Modekette möglich das Gesicht eines Promis für einen Monat zu mieten, um dies für eine aktuelle Werbekampagne zu nutzen. Die Fotoshootings müssten dann nicht mehr mit dem Promi selbst stattfinden, sondern könnten von einer Person mit einer ähnlichen Statur durchgeführt werden.

Doch nun möchte ich noch ein völlig anderes Thema ansprechen. Denn es ist ebenfalls wichtig zu beachten, dass die hinter den Deepfakes steckende Technologie nicht nur Gesichter austauschen kann. Grundsätzlich können damit sämtliche Objekte vertauscht werden, die eine genügend ähnliche Grundstruktur haben. Beispiele dafür sind das Umwandeln von Pferden in Zebras oder das wechseln eines Zeichenstils von einem Picasso in ein Van Gogh. Grenzen werden erst mit dem Ende der eigenen Phantasie erreicht.

Anfangs August wurde bekannt gegeben, dass erste forensische Tools durch die US Defense Advanced Research Project Agency (DARPA) erstellt wurden, um Deepfakes zu erkennen. Solche Tools, die anhand von Artificial Intelligence Deepfake-Videos von nicht gefälschten Videos unterscheiden können, sind allerdings ein zweischneidiges Schwert. Denn diese Tools können auch ausgetrickst werden, indem das Feedback zu einem Video, ob es Fake ist oder nicht, ebenfalls in den Lernalgorithmus einbezogen wird. Wenn ein Video korrekt als Fake erkannt wird, wird es solange verbessert beziehungsweise verändert, bis es von diesem Tool nicht mehr als Fake erkannt wird. So werden nur noch Fakes erstellt, die durch dieses spezifische Tool nicht mehr erkannt werden können.

Da es sich dabei offensichtlich nicht um eine vollständige Lösung handelt, sollen hier ein paar weitere Ideen aufgeführt werden, mit welchen die Erkennung von Fakes möglich sein könnte. Einerseits wäre es denkbar Wasserzeichen in offiziellen Videos einzuführen. Andererseits könnte man nur noch Videos als offiziell anerkennen, welche eine öffentlich publizierte Signatur haben. Dann kann die Echtheit des Videos überprüft werden, indem die Signaturen verglichen werden. Bei einer Abweichung der Signaturen, kann darauf geschlossen werden, dass es sich um ein verändertes Video handelt.

Schlussendlich noch ein Wort der Warnung. Es ist zu erwarten, dass das Umwandeln von Gesichtern irgendwann bereits dynamisch, während dem Erstellen eines Videos, geschehen kann. Es gibt bereits erste Studien, wie zum Beispiel in diesem wissenschaftlichen Paper Deep Video Portraits dargestellt.

Es existieren heute schon viele gute Beispiele von Deepfakes, konkrete Anforderungen für einen erfolgreichen Deepfake sind allerdings schwierig bis gar nicht aufzufinden. Die durch uns aufgebauten Testumgebung soll klare Aussagen dazu liefern, wie weit die aktuelle Deepfake-Technologie bereits ist und was die Anforderungen an das Bildmaterial ist, damit ein erfolgreicher Fake erstellt werden kann. Es wird anhand verschiedener Kriterien untersucht, was die Einschränkungen der heute vorhandenen Technologie sind. Zur Auswertung dieser Anforderungen wurden die folgenden Kriterien definiert:

Eine genauere Beschreibung sowie die Auswertung der hier aufgezählten Testfälle werden in weiteren Artikeln publiziert.

Unsere Spezialisten kontaktieren Sie gern!

Andrea Hauser

Andrea Hauser

Andrea Hauser

Andrea Hauser

Unsere Spezialisten kontaktieren Sie gern!