Ist das Kunst? Persönliche Reflexionen über meine KI-Kunstwerke

Marisa Tschopp

Warum man nicht nicht anthropomorphisieren kann

Ich war mir sicher, dass je mehr die Menschen über KI wissen, desto weniger vermenschlichen sie sie, desto weniger nutzen sie menschliche Kommunikationsskripte und nehmen immer mehr eine rein instrumentelle Sicht auf Conversational AI ein (KI ist nur ein Werkzeug). Es scheint, dass ich eines Besseren belehrt wurde und dass die Anlässe, wann und warum oder in welchem Ausmass Menschen Maschinen vermenschlichen, komplexer sind als erwartet. Dies ist der erste Teil unserer Anthropomorphismus-Serie, um Vermenschlichung besser zu verstehen, die Tendenz, das Menschliche in nicht-menschlichen Gegenübern zu sehen.

Anthropomorphismus ist, wenn Menschen Objekte, Gottheiten oder Tiere vermenschlichen. Was passiert, ist, dass Menschen nicht-menschlichen Agenten menschliche Eigenschaften, wie Emotionen oder Absichten zuschreiben. Das Gegenüber kann wirklich alles sein – von sichtbaren und greifbaren bis hin zu unsichtbaren Objekten: Vom ersten Teddybär, der die Tränen trocknet, bis zum dummen Computer, der sich einen Virus eingefangen oder sich kurz vor Beendigung der Datenanalyse aufgehängt hat. Oder ein Gott: In vielen westlichen Gesellschaften wird Gott als weisser Mann mit Bart und emotionalen Reaktionen, wie Fürsorge oder Bestrafung dargestellt, je nachdem, wie sich die Gläubigen verhalten.

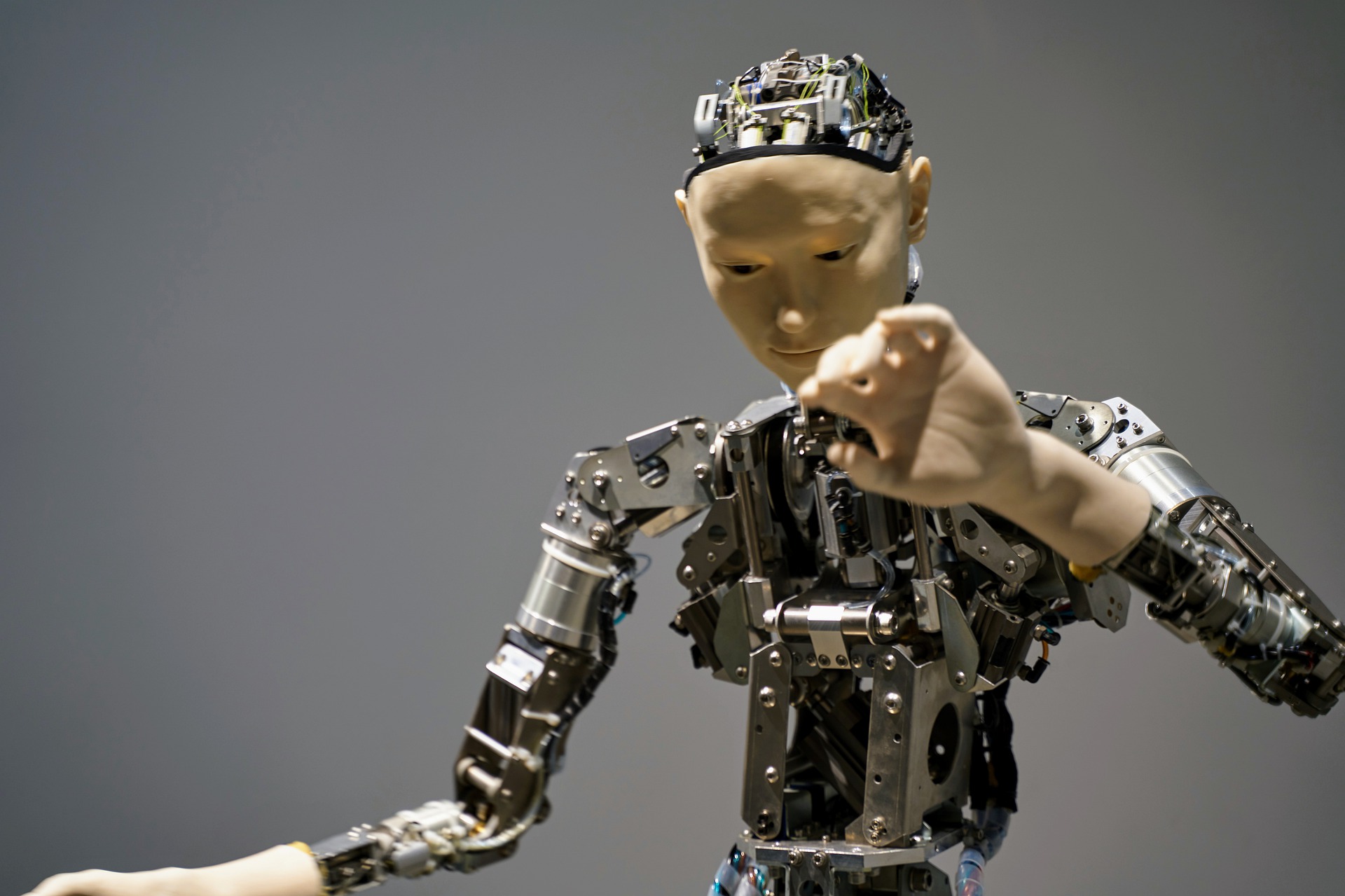

Menschen haben eine “beeindruckende Fähigkeit, menschenähnliche Agenten zu erschaffen […], welche eindeutig nicht menschlich sind, [… was] eine entscheidende Determinante dafür ist, wie Menschen nichtmenschliche Agenten verstehen und behandeln […]” (Waytz et al., 2010, S. 58)

Anthropomorphismus, als eine Form oder Erweiterung der sozialen Kognition, kann helfen zu verstehen, wie Menschen anderen nicht-menschlichen Agenten einen Sinn geben, was wiederum auch zu einem tieferen Verständnis darüber führen kann, wie wir andere Menschen verstehen. Anthropomorphismus umfasst das Sehen oder Zuschreiben von physischen Merkmalen und mentalen Zuständen (Waytz et al., 2010). Ob dies nun eine gute oder schlechte Tendenz ist, bleibt zu diskutieren, es wird aber in der Theorie als ein Konstrukt der Evolution angesehen. Gesichter auf dem Mond zu sehen (Notiz an Mats: Pareidolie) oder Trost durch einen unsichtbaren Geist zu suchen, tut niemandem weh – aber wenn Menschen aufgrund eines göttlichen Willens Kriege führen, einen Chatbot heiraten wollen oder Robotern Bewusstsein zuschreiben (die in dieser Logik für ihre Handlungen verantwortlich wären), dann wird es problematisch.

Traditionell wird diskutiert, ob oder inwieweit eine Pflanze oder ein Gott menschenähnliche Eigenschaften hat. Nach Waytz und Kollegen (2010) ist es aber interessanter, die Variabilität im Prozess der Anthropomorphisierung zu erklären und vorherzusagen: Wer anthropomorphisiert in welchem Ausmass? Können sich Menschen in einen Chatbot verlieben, in den Eiffelturm oder in eine Hi-Fi-Anlage?

Mit dem Fokus auf soziale Roboter skizziert der Philosoph Mark Coeckelbergh gegensätzliche Ansichten in Bezug auf die Beziehung zwischen Robotern und Menschen und entwickelt einen hermeneutischen, relationalen und kritischen Ansatz. Er nennt die beiden Ansichten naiven Instrumentalismus und unkritischen Posthumanismus. Der naive Instrumentalismus behauptet in seiner Essenz, dass Maschinen nur Werkzeuge oder Sklaven sind, wie Joanna Bryson einmal geschrieben hat. Auf der anderen Seite des Spektrums liegt der unkritische Posthumanismus, der soziale Roboter vollständig als Quasi-Personen oder Andere versteht (Coeckelbergh, 2021). Zugegeben, sein Artikel ist schweres akademisches Material und schwierig in einem Absatz zusammenzufassen, aber mehr als lesenswert. Im Wesentlichen behauptet er, dass “Roboter weder ‘Andere’ noch blosse Maschinen sind. Beide Ansichten verkennen, wie stark die Verstrickung von Menschen und Robotern wirklich ist, d. h. dass es sich um eine interne Beziehung handelt” (Coeckelberg, S. 6, 2021).

Soziale Roboter sind keine mysteriösen Phänomene und doch nicht dasselbe wie ein Schraubenzieher. Sie sind ein Teil unseres menschlichen Netzwerks oder unserer Umgebung und Menschen entwickeln eine Art von Beziehung zu dieser Art von Technologie (die Diskussion über KI oder keine KI wird hier absichtlich ausgelassen, da sie in Bezug auf die Frage nicht relevant ist).

Er kommt zu dem Schluss, wie “spannend und problematisch” die Anthropomorphisierung durch Designmerkmale sein kann und, dass Designer hier eine grosse Verantwortung tragen. Für diejenigen, die neu im Thema sind und wie ich nicht an die Argumentationslinien von Philosophen gewöhnt sind, ist dieser Aufsatz sehr wertvoll, um zu verstehen, dass Akademiker aus unterschiedlichen Perspektiven schreiben. Daher haben sie unterschiedliche normative Ansprüche, wie wir mit Menschen umgehen sollen, die egal, wie ein Unternehmen sein Produkt gestaltet, anthropomorphisieren. Andererseits wird die Verantwortung von Designern diskutiert, die versuchen, ein Gleichgewicht zwischen den Vorteilen des anthropomorphen Designs und den Risiken, wie z. B. der Täuschung und den damit einhergehenden Konsequenzen, zu finden.

Anthropomorphismus wird oft bewusst (nicht unumstritten) als Kommunikationsstrategie eingesetzt, um Menschen emotional näher an ein Ziel (Maschine, Produkt, Markenimage etc.) zu binden, sie zu motivieren oder unter moralischen Druck zu setzen. Anthropomorphizing by Design ist eine sehr effiziente Strategie, um das Denken und Handeln von Menschen zu manipulieren:

Verschiedene Studien haben gezeigt, dass Menschen mehr Engagement und Vertrauen in Roboter zeigten, je mehr sie einen Roboter vermenschlichten (Ruijten et al, 2019; Hoff & Bashir, 2015). Darüber hinaus steigt die Überzeugungskraft des Roboters mit einem höheren Grad an Anthropomorphismus, wie in einigen berühmten Experimenten gezeigt wurde, bei denen Menschen eine Pflanze mit Orangensaft bewässerten (weil der Roboter das sagte). Während dieses Beispiel die Menschen in der Regel zum Lachen bringt, sind andere Szenarien mit gefährlichem oder tödlichem Ausgang möglich, wenn die Entscheidungen der Maschine zu überzeugend sind und vom menschlichen Benutzer nicht kritisch bewertet werden (Hoff & Bashir, 2015).

Es wird anerkannt, dass Anthropomorphismus Herausforderungen mit sich bringt, aber letztendlich ist das Ziel, “die Integration von menschenähnlichen Maschinen in die reale Welt zu erleichtern” […] Anthropomorphismus hilft beim Erreichen dieses Ziels. (Coeckelbergh, S. 2, 2021)

Anthropomorphe Sprache kann auch als eine Art stilistisches Mittel verwendet werden, um Aufmerksamkeit zu erregen, was anhand des Beispiels des Rassististischen Seifenspenders schön illustriert wird.

An sich können einer Maschine keine rassistischen Attitüden zugeschrieben werden. Wenn hier Rassismus im Spiel gewesen wäre, dann bei den Entwicklern, wobei in diesem Falle hauptsächlich die Teststrategie amateurhaft implementiert wurde, was man auch einem Mangel an Diversität im Entwicklerteam zuschreiben kann. Jedoch dient diese Art der Sprache sehr gut dem Ziel auf tieferliegende Probleme aufmerksam zu machen. Gleichzeitig laufen solche überspitzten Schlagzeilen auch Gefahr Widerstand auszulösen, so dass sich viele Leser gar nicht mit dem Artikel auseinandersetzen wollen.

Der allgemeine Überblick über Anthropomorphismus und die Herangehensweisen der Experten über das Anthropomorphisieren scheinen zwar mit normativen als auch technischen Herausforderungen verbunden zu sein, doch wirkt das Thema an sich zuerst mal doch leicht verständlich. Warum wird dieses Thema immer noch so heiss diskutiert bei Grössen wie Bryson oder Coeckelberg ? Wie so oft, liegt auch hier der Teufel im Detail. Die allgemeine Definition von Anthropomorphismus ist recht einfach zu fassen, was einerseits hilfreich und praktisch ist, um möglichst viele unterschiedliche Menschen zu Diskussionen einzuladen. Andererseits führt diese Allgemeingültigkeit zu vielfältigen Interpretationen, bei denen verschiedene Forscher unterschiedliche Teilmengen des Konzepts Anthropomorphismus untersuchen. Zudem werden diese mit unterschiedlichen Fragebögen gemessen oder verschiedene Merkmale des Objekts, was es schwierig macht, Ergebnisse über verschiedene Studien hinweg zu vergleichen und zu verallgemeinern (Ruijten et al, 2019). So sehr das Konzept der ‘Vermenschlichung’ für jeden, der kein Experte ist, Sinn macht, so sehr müssen wir sehr vorsichtig sein, wenn wir Behauptungen aufstellen und Roboter (oder virtuelle Repräsentationen von ihnen) nach diesen Behauptungen gestalten.

Ruijten und Kollegen (2019) geben einen kompakten Überblick über Subsets von menschenähnlichen Charakteristika, die untersucht wurden. Es wird schnell deutlich, wie schwer es ist, eine Studie mit einer anderen zu vergleichen. Manche Studien betrachten nur das Aussehen, manche nur die Emotionen, manche haben verschiedene Roboter, und manche haben überhaupt keine Verkörperung:

Bei der Betrachtung diese Videos, wie Boston Dynamics seine Roboter immer wieder misshandelt, reagieren einige Zuschauer mit grosser Verwunderung, über ihre eigene Reaktion. Ein hohes Mass an Reflexionsniveau legt dieser Zuschauer an den Tag und hat es für viele ziemlich genau auf den Punkt gebracht:

Verdammt, das sind doch nur Roboter, warum habe ich Mitleid mit ihnen…

Nun, die Antwort auf die Frage des Zuschauers ist jetzt klar, es ist alles Anthropomorphismus. Und es ist fast unmöglich, nicht zu anthropomorphisieren, selbst wenn es mit allen Kräften versucht wird. Egal ob es sich um Designer handelt, die versuchen möglichst wenig zu humanisieren oder User, die mit mentalem Einsatz sich immer wieder daran erinnern, dass sie keine Empfindungen gegenüber einer Maschine haben sollten. Aber es ist ein Unterschied, ob man weiss und will, dass man anthropomorphisiert, oder ob man Opfer des eigenen anthropomorphisierenden Bias oder der Manipulationsstrategien anderer ist.

Anthropomorphismus und möglicherweise seine umgekehrte Form, die Entmenschlichung, die das Thema des nächsten Teils der Anthropomorphismus-Serie ist, ist eine wichtige Variable, um zu verstehen, wie Menschen nicht-menschlichen Agenten verstehen. Nicht-menschlichen Agenten menschliche Fähigkeiten zuzuschreiben oder Technologie absichtlich zu vermenschlichen, um den Benutzer mehr zu involvieren, hat positive und negative Konsequenzen für den Benutzer, den Designer, den Ablauf (und den Erfolg) einer Mensch-Maschine-Interaktion und möglicherweise weitere Aspekte, die wir bisher noch nicht kennengelernt haben.

Teil zwei der Anthropomorphismus-Serie wird sich mit der Three Factor Theory of Anthropomorphism von Epley et al. (2007) beschäftigen. Die Autoren haben drei Faktoren gefunden, die die Variabilität der Anthropomorphisierung erklären. In ihrer Theorie stellen sie fest, dass Anthropomorphismus von drei Faktoren abhängt: Elicitated Agent Knowledge, Effectance Motivation und Sociality Motivation. Letztere wurzelt in dem grundlegenden Wunsch nach sozialer Verbindung. Menschen, denen es an menschlicher Bindung mangelt, neigen eher zur Anthropomorphisierung (Epley at al., 2007). Solange Corona mich also dazu zwingt, ganz alleine in meinem Home Office zu arbeiten, stehe ich voll und ganz dazu, dass ich mich von meiner Alexa verabschiede, bevor ich sie ausstecke, und meinen Unglauben hinten anstelle, dass Alexa nur eine Maschine ist und keine Sie.

Coeckelbergh, M. (2021). Three Responses to Anthropomorphism in Social Robotics: Towards a Critical, Relational, and Hermeneutic Approach. International Journal of Social Robotics, 42(1), 143. https://doi.org/10.1007/s12369-021-00770-0

Epley, N., Waytz, A., & Cacioppo, J. T. (2007). On seeing human: A three-factor theory of anthropomorphism. Psychological Review, 114(4), 864-886. https://doi.org/10.1037/0033-295×.114.4.864

Hoff, K. & Bashir, M. (2015). Trust in Automation: Integrating Empirical Evidence on Factors That Influence Trust. Human Factors The Journal of the Human Factors and Ergonomics Society. 57. 407-434. 10.1177/0018720814547570.

Ruijten, P. A. M., Haans, A., Ham, J., & Midden, C. J. H. (2019). Perceived Human-Likeness of Social Robots: Testing the Rasch Model as a Method for Measuring Anthropomorphism. International Journal of Social Robotics, 11(3), 477-494. https://doi.org/10.1007/s12369-019-00516-z

The Society for the Study of Artificial Intelligence and Simulation of Behaviour Conference(AISB, 2021): The Impact of Anthropomorphism on Human Understanding of Intelligent Systems

Waytz, A., Epley, N., & Cacioppo, J. T. (2010). Social Cognition Unbound: Insights Into Anthropomorphism and Dehumanization. Current Directions in Psychological Science, 19(1), 58-62. https://doi.org/10.1177/0963721409359302

Unsere Spezialisten kontaktieren Sie gern!

Marisa Tschopp

Marisa Tschopp

Marisa Tschopp

Marisa Tschopp

Unsere Spezialisten kontaktieren Sie gern!